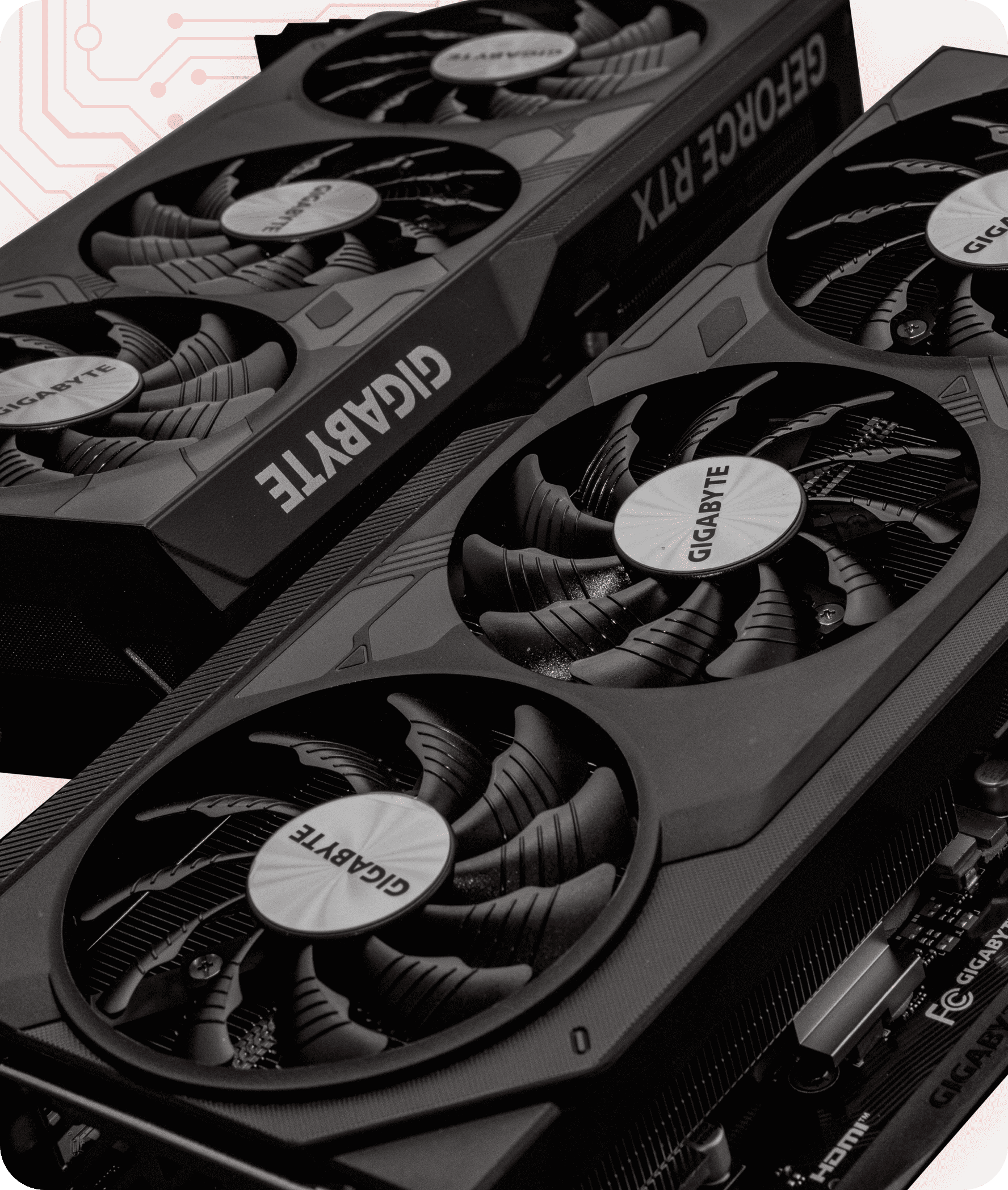

Your Trusted Web Hosting Partner Since 2008. Get VPS Now!

Support +373 79 600002

- Have Questions?

-

Open Ticket

-

+373 79 600002

-

info@alexhost.com

-

Telegram Live Chat

-

Telegram Official

-

F.A.Q

中文 (中国)

Support +373 79 600002

- Have Questions?

Open Ticket

-

+373 79 600002

-

info@alexhost.com

-

Telegram Live Chat

-

Telegram Official